AI-Toolkit @ DGX Spart GB10 – 安裝教學

AI-Toolkit @ DGX Spart GB10

安裝步驟

要在 DGX OS 上執行 AI Toolkit,需要使用 Python 3.11。最簡單的方法是在不影響系統 Python 安裝的情況下,使用Miniconda創建一個虛擬環境,這樣就可以指定環境中要使用的 Python 版本。

1) 取得Python 3.11(透過miniconda)

安裝最新版本的miniconda:

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-aarch64.sh

chmod u+x Miniconda3-latest-Linux-aarch64.sh

./Miniconda3-latest-Linux-aarch64.sh重新啟動你的 bash 或 ssh 會話。如果 miniconda 安裝成功,它預設會自動載入「base」環境。基本上可以停用此功能,請執行:

conda config --set auto_activate_base false為 ai-toolkit 建立一個 Python 3.11 環境:

conda create --name ai-toolkit python=3.11然後使用以下命令啟動環境:

conda activate ai-toolkit2) 安裝官方的 PyTorch

pip3 install torch==2.9.1 torchvision==0.24.1 torchaudio==2.9.1 --index-url https://download.pytorch.org/whl/cu1303) 安裝AI-Toolkit

git clone https://github.com/ostris/ai-toolkit.git

cd ai-toolkit4) 安裝失敗的解決方案

如果使用官方的安裝會失敗,因為scikit-learn會用舊的1.1.2版,所以在安裝 dgx_requirements.txt 之前 我們要先建立一個 constraint.txt:

echo "scikit-learn>=1.3.2" > constraint.txt

echo "numpy> constraint.txt5) 安裝剩餘的依賴項

pip cache purge

pip install -r dgx_requirements.txt -c constraint.txt6) 再來把Python 環境中缺少 FFmpeg 的系統級函式庫補上

conda install -c conda-forge ffmpeg7) 統一 PyTorch 生態系編譯版本(解決 undefined symbol 與 ARM 架構問題)

GB10 是 ARM 架構,一般的 PyPI 預設套件會報錯。我們必須清空舊包,並直接從官方的 Nightly 通道拉取為 CUDA 13.0 同步編譯的 ARM 版:

pip uninstall -y torch torchvision torchaudio torchcodec

pip install --pre torch torchvision torchaudio torchcodec --index-url https://download.pytorch.org/whl/nightly/cu130安裝完後..試著下面的指令:

python -c "import torch; import torchcodec; print(f'裝置名稱: {torch.cuda.get_device_name(0)}'); print(f'CUDA 版本: {torch.version.cuda}'); print(f'Torchcodec 版本: {torchcodec.__version__}'); print(f'GPU 可用狀態: {torch.cuda.is_available()}')"應該會出現:

裝置名稱: NVIDIA GB10

CUDA 版本: 13.0

Torchcodec 版本: 0.12.0.dev20260411+cu130

GPU 可用狀態: True這樣基本上核心已經安裝完畢。

8) Hugging Face 模型下載權限問題

如果在DGX GB10上有其它和huggingface下載模型有相關的服務(例如vLLM),有可能會出現目錄權限被鎖定無法下載模型的問題。首先先建立想放模型的目錄:

mkdir -p {你的ai-toolkit目錄}/hf_cache再來設定環境變數(未來重開機這個變數要重新設定):

export HF_HOME="{你的ai-toolkit目錄}/hf_cache"WebUI 安裝/執行

1) 安裝 npm(如需要)

sudo apt install npm2) 啟動 WebUI

cd ui

npm run build_and_start出現類似下面的訊息..就代表已經完成:

[UI] ▲ Next.js 15.5.9

[UI] - Local: http://localhost:8675

[UI] - Network: http://{你的機器IP}:8675

[UI] ✓ Starting...

[UI] ✓ Ready in 358ms這時到瀏覽器,用 http://{你的機器IP}:8675 就可以開始訓練LoRA囉!🎉

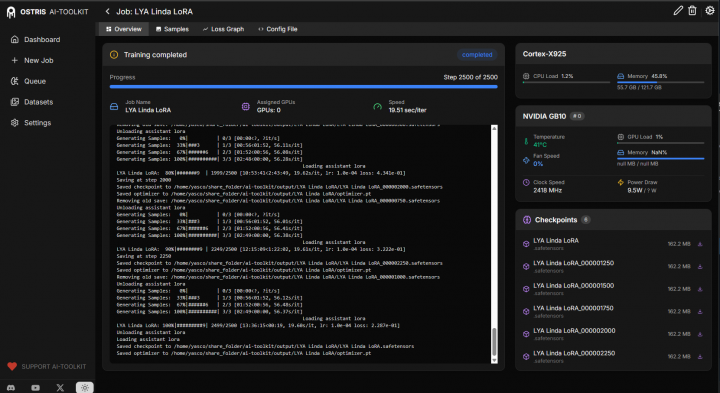

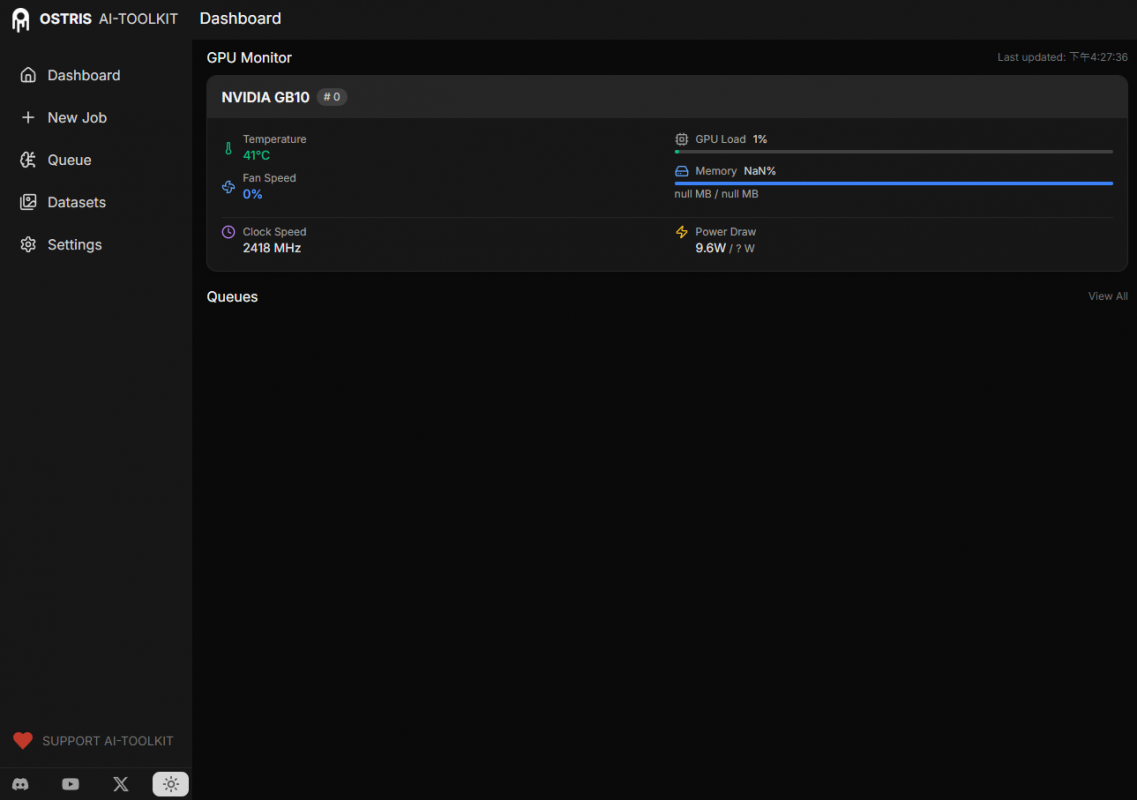

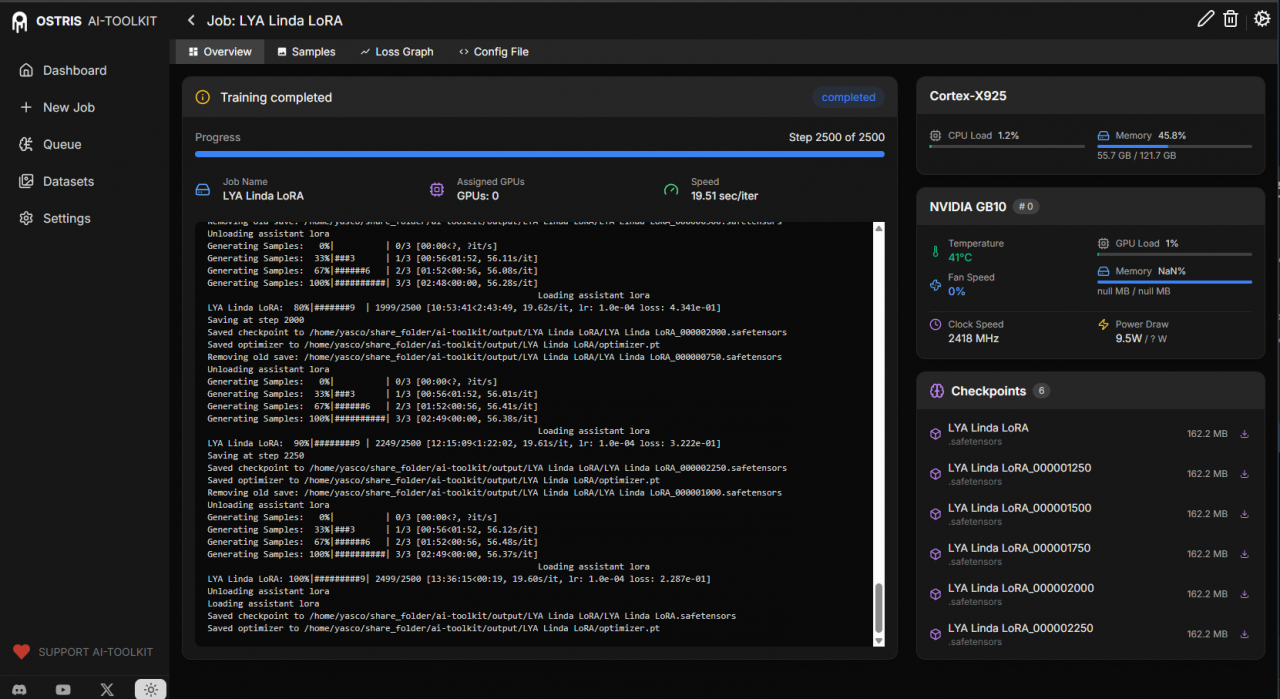

畫面中的記憶體看不到是正常的.. 因為GB10是共用記憶體.. 在開始建立訓練資料時就會看到了(如下圖)

未來如果有重新開機…只要用下面的步驟執行即可.

conda activate ai-toolkit

export HF_HOME="{你的ai-toolkit目錄}/hf_cache"

cd {你的ai-toolkit目錄}/ui

npm run build_and_start